Conférence OpenAI : démos bluffantes de GPT-4o

Hier soir, OpenAI lors d’une conférence d’une trentaine de minute a grillée la politesse à Google en annonçant la nouvelle version de son moteur conversationnel Omnicanal (le « o » de GPT 4o). Autant le dire tout de suite les démonstrations ont été bluffantes. On peut revoir tout cela directement sur le site d’OpenAI ici. On retrouve en résumé une nouvelle application desktop (uniquement pour Mac dans un premier temps, Windows plus tard dans l’année) de ChatGPT, des capacités multimodales décuplées et des interactions rapides et très naturelles. Dans les démonstrations, on a le sentiment d’un véritable dialogue avec l’assistant, avec des intonations de voix, la simulation d’émotions ou la possibilité de l’interrompre pour enchainer sur un autre sujet. On est très très loin d’un dialogue à la Siri ou Alexa…

On retrouve aussi un meilleure capacité de compréhension d’une image et de son contenu exploitée pour décrire une scène pour un non voyant par exemple mais également observer les subtilité de cette dernière qui nous aurait échappé. Ou encore lui présenter une simple copie d’écran pour qu’il réagisse sur son contenu (comme un bout de code par exemple)…

La réponse de Google sur le thème « reviens Léon j’ai les même à la maison » ne s’est pas fait attendre. L’entreprise n’a pas pu attendre le début de la Google I/O qui commence aujourd’hui pour publier quelques vidéos sur X. On se souvient que les réactions précipités ne sont pas toujours opportunes (cf ses premières démo de Bart / Gemini). On attendra sa réponse plus stratégique ce soir.

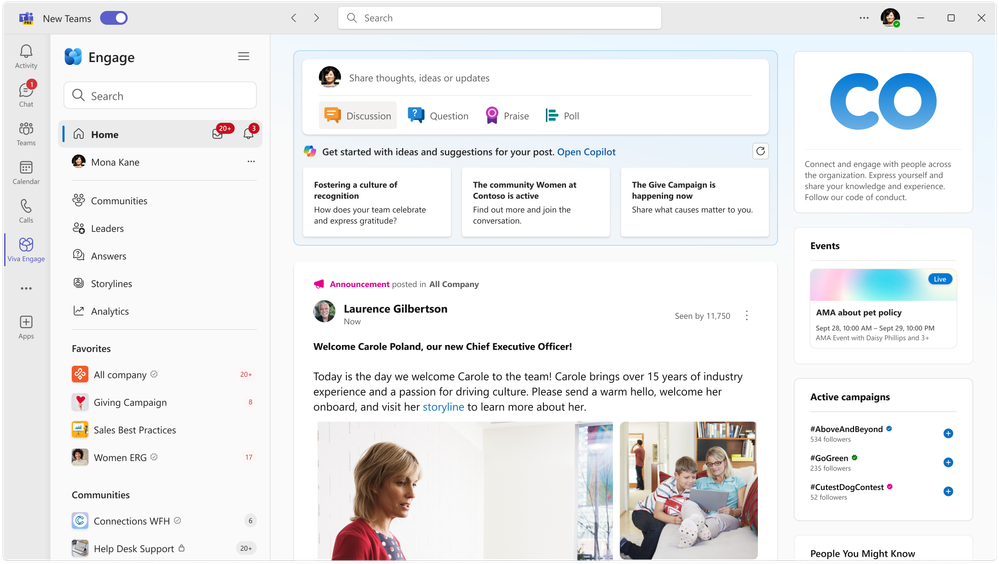

Autre acteur, dont on attend aussi à minima l’intégration de ces fonctions, Microsoft qui pourrait bien annoncer une intégration rapide dans son offre Copilot dès le début de la Build la semaine prochaine. Puis se sera au tour d’Apple le 10 juin de nous présenter (ou pas) cette intégration dans IOS 18 ?

En tout cas, nous reviendrons sur tout ceci lors du prochain Briefing