Phi-4 15B : Le modèle qui « décide » de réfléchir (ou pas)

Le géant de Redmond vient de libérer les poids de son dernier-né, le Phi-4-reasoning-vision-15B. Dans un marché saturé de modèles aux paramètres gargantuesques, Microsoft persiste dans sa stratégie de « Small Language Models » (SLM) avec une proposition de 15 milliards de paramètres. L’argument de vente ? Une capacité inédite à décider de manière autonome s’il doit activer son mode « raisonnement » ou fournir une réponse instantanée. Une sorte de libre arbitre algorithmique qui, sur le papier, fait rêver les DSI en quête d’optimisation de ressources, mais qui laisse les architectes dubitatifs face à l’imprévisibilité de la latence.

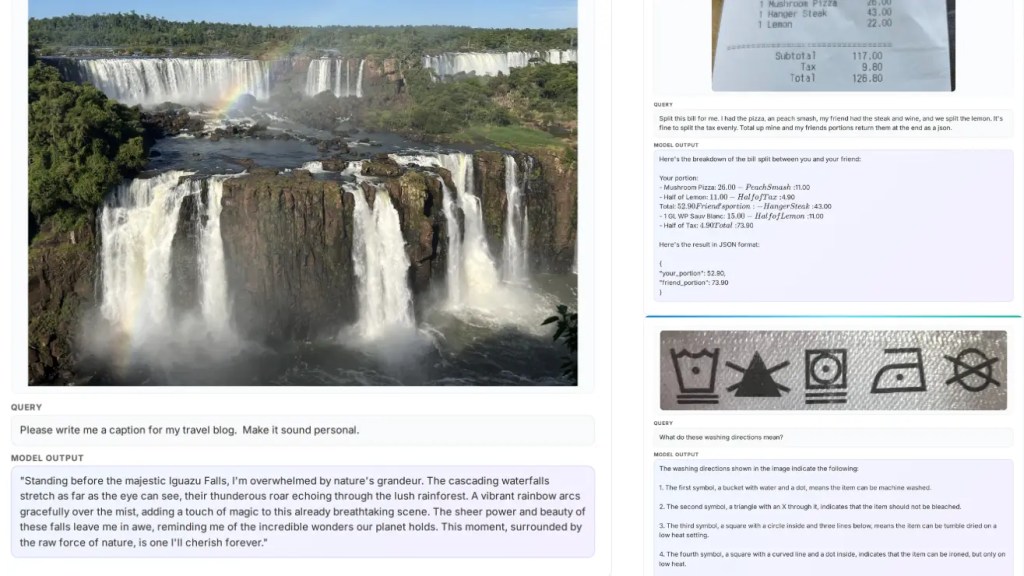

D’un point de vue technique, l’approche est audacieuse. Contrairement aux modèles de raisonnement classiques (type OpenAI o1) où le passage par une chaîne de pensée est souvent imposé ou activé manuellement, Phi-4 tente de juger de la complexité de l’input (mathématiques avancées, analyse d’interface utilisateur, légendes d’images) pour doser son effort. Si l’efficience est louable — le modèle n’a été entraîné que sur 200 milliards de tokens, un chiffre dérisoire face aux trilliards habituels — on peut s’interroger sur la qualité réelle de ce discernement. Un modèle qui « choisit » quand réfléchir est aussi un modèle dont on ne peut prédire avec certitude le temps de réponse en production. Pour un architecte système, cette variabilité est un cauchemar de monitoring.

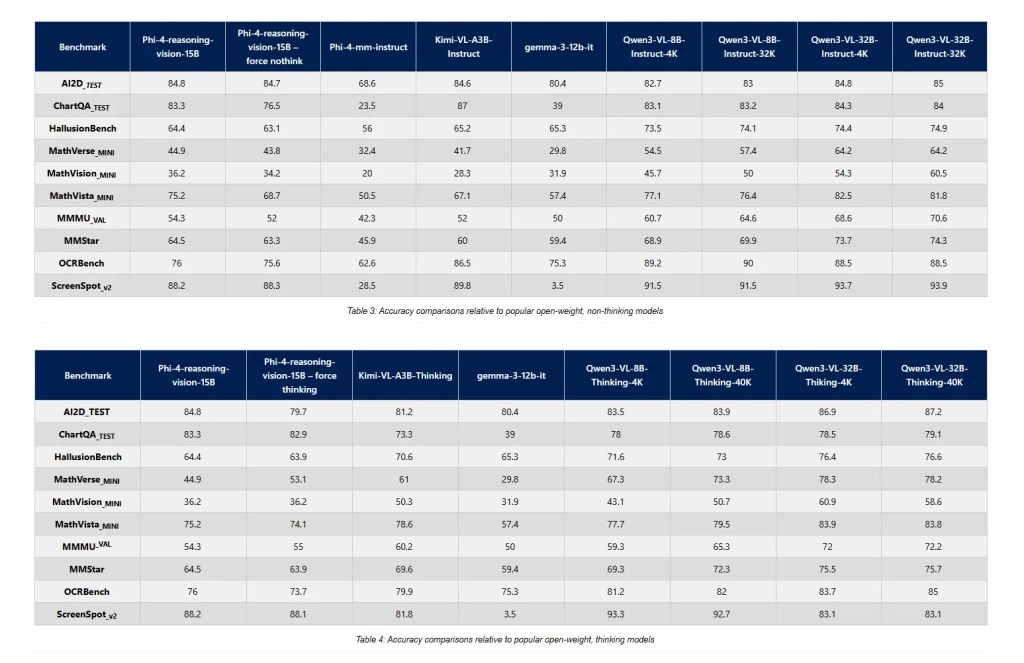

Plus piquant encore : Microsoft admet avoir utilisé GPT-4o pour assister l’entraînement de Phi-4. On assiste donc à une forme de distillation supervisée où le petit frère tente d’imiter l’aîné, tout en essayant d’être plus sobre. Les benchmarks présentés sont d’une honnêteté presque désarmante, montrant que Phi-4 se fait parfois distancer par ses concurrents (notamment les modèles chinois comme Qwen). Microsoft semble ici jouer la carte de l’infrastructure plutôt que celle de la performance brute, préférant fournir des modèles « open-weight » faciles à déployer sur Azure ou en local, plutôt que de chercher à détrôner les leaders du raisonnement pur.

En résumé, Phi-4 15B est une belle prouesse d’ingénierie logicielle et une démonstration d’efficience énergétique. Cependant, confier la décision de « réfléchir » à une boîte noire de 15B paramètres reste un pari risqué. Pour les entreprises, c’est un outil intéressant pour des tâches spécifiques de vision et de logique, à condition de ne pas être trop regardant sur la régularité des performances.