Agents IA : Le futur du travail entre autonomie et surveillance…

C’est peu de le dire que le rythme des innovations en intelligence artificielle s’accélère rapidement, avec des capacités autrefois clairement inimaginables devenant peu à peu réalité. Une des tendances majeures de cette évolution est l’émergence des fameux « agents IA », ces sortes de collaborateurs virtuels destinés à travailler à nos côtés, voire à terme de manière totalement autonome. Microsoft l’avait imaginé assez tôt y compris dans l’appellation de ses offres « Copilot ». On apprend aujourd’hui que selon les prévisions de Gartner, d’ici 2028, au moins 15 % des décisions quotidiennes de travail seront prises de manière autonome par des agents IA.

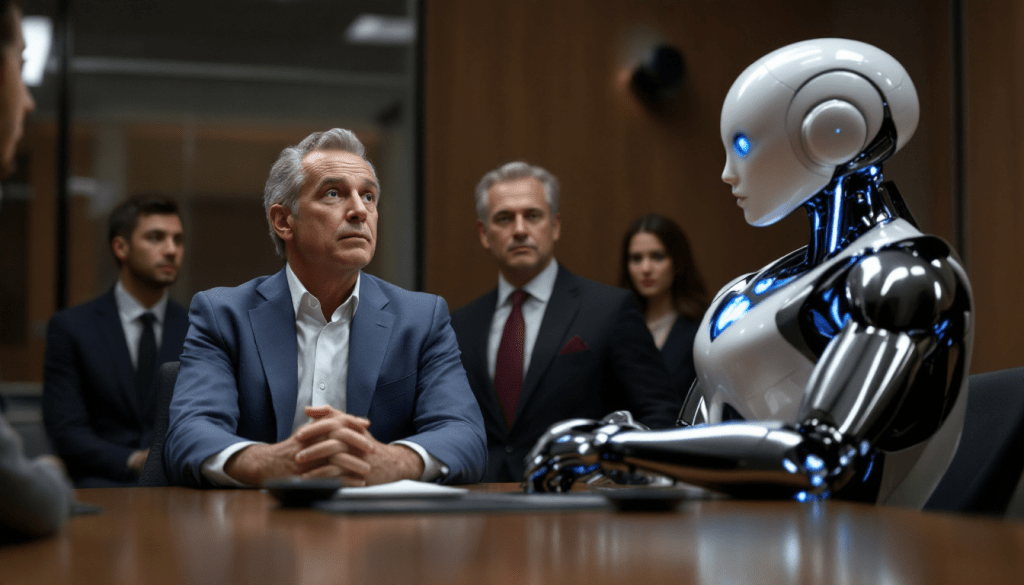

Ces agents IA, également appelés agents autonomes, représentent l’une des avancées les plus significatives dans le domaine de l’automatisation. Si l’objectif premier de ces agents est de décharger les équipes humaines des tâches répétitives et chronophages, comme la surveillance des systèmes. Là où cela devient intéressant, mais aussi effrayant un peu quand même, c’est quand ces agents, ne se contenteront plus de surveiller, mais prendront aussi des décisions et des actions correctives en temps réel. Demain nous serons soit accompagné de collègues humains soit pourquoi pas de collègue IA…

Un élément essentiel : la confiance dans ces agents IA…

Avec l’intégration croissante des agents IA dans nos vies professionnelles, la question de la gouvernance devient cruciale. Comment gérer cette nouvelle main-d’œuvre numérique ? Selon Gartner, des plateformes de gouvernance de l’IA verront le jour pour contrôler la performance légale, éthique et opérationnelle des systèmes IA. Ces outils permettront aux entreprises de garantir que leurs systèmes IA fonctionnent de manière transparente, en vérifiant notamment l’absence de biais dans les décisions prises. En intégrant la gouvernance dès la création des modèles IA, les organisations pourront ainsi instaurer la confiance. C’est un élément fondamental car comme toute technologie, si les gens perdent confiance dans l’IA, ils cesseront de l’utiliser.

…face également à la désinformation générée par des IA

L’intelligence artificielle a également permis aux acteurs malveillants de propager des désinformations à une échelle sans précédent. Des outils sophistiqués, comme les deepfakes et les attaques par hameçonnage, menacent de plus en plus les entreprises et les individus. C’est ici que la sécurité de la désinformation entre en jeu. Cette nouvelle catégorie de sécurité cherche à évaluer l’authenticité des informations, surveiller leur diffusion et prévenir les usurpations d’identité. Selon Gartner d’ici 2028, la moitié des entreprises adopteront des solutions de sécurité contre la désinformation, un bond spectaculaire par rapport aux moins de 5 % actuels…

Les interfaces cerveau-machine en ligne de mire

Enfin, Gartner anticipe une montée en puissance des interfaces cerveau-machine bidirectionnelles (BBMI), une technologie encore balbutiante mais prometteuse. Ces interfaces pourraient un jour améliorer les capacités cognitives des humains, permettant aux travailleurs de rester pertinents dans un monde professionnel dominé par l’IA. En 2030, Gartner prévoit que 30 % des travailleurs du savoir utiliseront des technologies BBMI, contre moins de 1 % aujourd’hui. Si ces technologies peuvent améliorer la productivité et l’apprentissage, elles soulèvent également des questions éthiques majeures sur leur utilisation et les risques potentiels pour la vie privée et la santé mentale.

Conclusion

L’avenir des agents IA et des technologies connexes ouvre la voie à des transformations profondes dans le monde du travail. Si certaines de ces innovations peuvent effrayer, elles offrent également des opportunités considérables pour améliorer la productivité, l’apprentissage et la sécurité. Toutefois, la question de la gouvernance et de la confiance reste centrale pour garantir que cette révolution technologique se déroule de manière éthique et bénéfique pour tous. Nous reparlerons de tout ceci lors du prochain Briefing Calipia, n’hésitez pas à nous rejoindre.