Microsoft met à disposition un outil pour tester la sécurité des solutions IA

Counterfit est le nom de l’outil open source mis à disposition par Microsoft pour tester la sécurité des algorithmes IA. Développé initialement pour les besoins propres de l’entreprise, « Counterfit aide les organisations à réaliser des évaluations des risques de sécurité de l’IA pour s’assurer que les algorithmes utilisés dans leurs entreprises sont robustes, fiables et dignes de confiance« .

Disponible sur GitHub, cet outil va permettre d’automatiser des simulations d’attaque sur des modèles IA, offrant selon Microsoft 3 avantages :

- les modèles peuvent être hébergés on premise, dans le cloud ou en périphérie (Edge).

- l’outil fait abstraction du fonctionnement interne des modèles IA à tester afin que les tests se concentrent sur l’évaluation de la sécurité.

- Counterfit s’efforce d’être agnostique en matière de données : il fonctionne avec des modèles d’IA utilisant du texte, des images ou des données génériques.

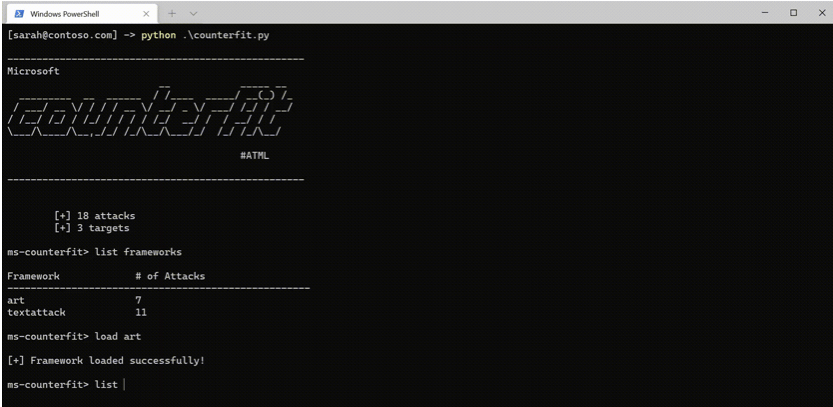

Accessible en mode commande, Counterfit reprend des modes d’attaque et des terminologies familières aux spécialistes de la sécurité qui mettent en oeuvre des outils de test.

Ping : IoT et Sécurité : Microsoft rachète ReFirm Labs | Calipia : le blog